引言:为什么需要微服务监控?

在现代软件工程中,云原生架构已成为构建高可用、可扩展系统的核心范式。随着业务复杂度的提升,传统的单体应用逐渐被拆分为多个独立部署的微服务。每个微服务负责一个特定的业务功能,通过轻量级通信协议(如HTTP/REST、gRPC)进行协作。

然而,这种分布式架构也带来了新的挑战——可观测性(Observability) 的缺失将导致系统难以调试、性能瓶颈难以定位、故障响应滞后。因此,建立一套完整的微服务监控体系,是保障系统稳定运行的关键。

在众多可观测性解决方案中,Prometheus 和 Grafana 凭借其开源、灵活、强大的特性,已经成为云原生生态中最主流的组合之一。本指南将带你从零开始,构建一个基于 Prometheus + Grafana 的微服务监控体系,涵盖指标采集、数据可视化、告警策略配置等核心环节,并提供大量实际代码示例与最佳实践建议。

一、云原生监控体系的核心要素

在设计微服务监控体系之前,我们需要明确其核心目标和组成要素:

1.1 可观测性的三大支柱

根据 Google SRE 框架,可观测性由三个支柱构成:

| 支柱 | 说明 |

|---|---|

| 指标(Metrics) | 数值型数据,如请求延迟、错误率、吞吐量等,用于衡量系统健康状态 |

| 日志(Logs) | 事件记录,用于追踪具体行为或异常上下文 |

| 链路追踪(Tracing) | 跨服务调用路径分析,识别性能瓶颈 |

虽然本文聚焦于 指标监控,但完整的可观测性应整合这三者。我们将在后续章节中提及如何与 OpenTelemetry 集成以支持日志与链路追踪。

1.2 微服务监控的关键需求

- 细粒度指标采集:每个微服务需暴露自身运行状态指标

- 自动服务发现:动态感知新增/下线的服务实例

- 多维标签化数据:支持按服务名、版本、环境、区域等维度查询

- 实时性与高可用性:数据采集与展示低延迟,且系统本身具备容错能力

- 灵活告警机制:基于阈值、趋势、模式触发告警

- 可视化与自定义仪表盘:便于团队快速理解系统状态

✅ 选择 Prometheus + Grafana 正是因其完美契合上述需求。

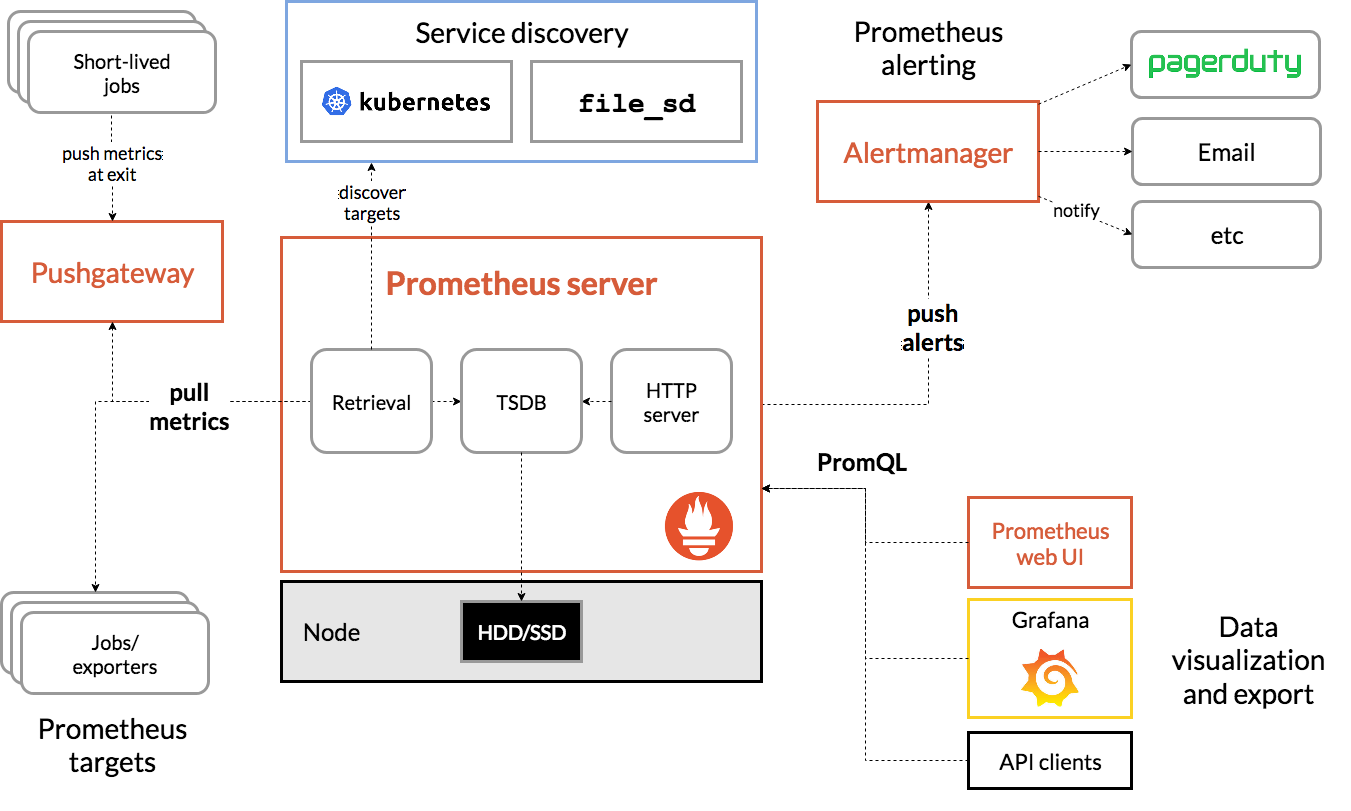

二、Prometheus 架构与工作原理

2.1 Prometheus 系统架构概览

Prometheus 采用“拉取(Pull)”模型,主要组件包括:

| 组件 | 功能 |

|---|---|

| Prometheus Server | 核心组件,负责定时抓取指标数据、存储、查询与告警 |

| Exporter | 用于暴露目标系统的指标(如 Node Exporter、Blackbox Exporter) |

| Pushgateway | 临时推送短期任务指标(不推荐用于长期服务) |

| Alertmanager | 告警路由、抑制、静音与通知分发 |

| Client Libraries | 各语言客户端库,方便微服务直接暴露指标 |

⚠️ 注意:不推荐使用 Pushgateway 作为常规服务指标推送方式,仅适用于批处理作业或短生命周期任务。

2.2 指标类型详解

Prometheus 支持四种标准指标类型:

-

Counter(计数器)

- 单调递增,用于统计事件总数(如请求数)

- 示例:

// Go 客户端示例 var requestCounter = promauto.NewCounterVec( prometheus.CounterOpts{ Name: "http_requests_total", Help: "Total number of HTTP requests.", }, []string{"method", "endpoint", "status"}, )

-

Gauge(仪表盘)

- 可增可减,表示当前数值(如内存使用量、活跃连接数)

- 示例:

var memoryUsageGauge = promauto.NewGaugeVec( prometheus.GaugeOpts{ Name: "process_memory_bytes", Help: "Current process memory usage in bytes.", }, []string{"job"}, )

-

Histogram(直方图)

- 统计分布情况,常用于响应时间

- 自动划分桶(buckets),输出

sum与count - 示例:

var requestDuration = promauto.NewHistogramVec( prometheus.HistogramOpts{ Name: "http_request_duration_seconds", Help: "Request duration in seconds.", Buckets: prometheus.DefBuckets, // [0.005, 0.01, 0.025, ..., 10] }, []string{"method", "endpoint"}, )

-

Summary(摘要)

- 类似于 Histogram,但更高效地计算分位数(quantiles)

- 通常用于对延迟敏感场景

- 示例:

var requestLatencySummary = promauto.NewSummaryVec( prometheus.SummaryOpts{ Name: "http_request_latency_seconds", Help: "Request latency in seconds.", Objectives: map[float64]float64{0.5: 0.05, 0.9: 0.01, 0.99: 0.001}, }, []string{"method", "endpoint"}, )

🔍 最佳实践:优先使用

Histogram进行延迟监控,避免过度依赖Summary(因其计算开销较高)

三、微服务集成 Prometheus 指标采集

3.1 使用 Go 语言实现指标暴露

以下是一个典型的 Go 微服务框架(基于 Gin)集成 Prometheus 的完整示例:

1. 添加依赖

// go.mod

require (

github.com/prometheus/client_golang v1.14.0

github.com/gin-gonic/gin v1.9.1

)

2. 初始化 Prometheus 客户端

// metrics.go

package main

import (

"github.com/prometheus/client_golang/prometheus"

"github.com/prometheus/client_golang/prometheus/promauto"

)

var (

requestCounter = promauto.NewCounterVec(

prometheus.CounterOpts{

Name: "http_requests_total",

Help: "Total number of HTTP requests.",

},

[]string{"method", "endpoint", "status"},

)

requestDuration = promauto.NewHistogramVec(

prometheus.HistogramOpts{

Name: "http_request_duration_seconds",

Help: "Request duration in seconds.",

Buckets: prometheus.DefBuckets,

},

[]string{"method", "endpoint"},

)

activeRequestsGauge = promauto.NewGauge(

prometheus.GaugeOpts{

Name: "http_active_requests",

Help: "Number of currently active HTTP requests.",

},

)

)

3. 中间件封装:自动埋点

// middleware/metrics.go

package middleware

import (

"net/http"

"time"

"your-app/metrics"

"github.com/gin-gonic/gin"

)

func PrometheusMiddleware() gin.HandlerFunc {

return func(c *gin.Context) {

start := time.Now()

// 增加活跃请求数

metrics.ActiveRequestsGauge.Inc()

defer metrics.ActiveRequestsGauge.Dec()

c.Next()

// 记录请求耗时

latency := time.Since(start).Seconds()

requestDuration.WithLabelValues(c.Request.Method, c.FullPath()).Observe(latency)

// 记录请求总数

statusCode := c.Writer.Status()

requestCounter.WithLabelValues(c.Request.Method, c.FullPath(), http.StatusText(statusCode)).Inc()

}

}

4. 注册监控端点

// main.go

package main

import (

"net/http"

"github.com/gin-gonic/gin"

"github.com/prometheus/client_golang/prometheus/promhttp"

"your-app/middleware"

)

func main() {

r := gin.Default()

// 启用 Prometheus 中间件

r.Use(middleware.PrometheusMiddleware())

// 注册 API 路由

r.GET("/ping", func(c *gin.Context) {

c.JSON(http.StatusOK, gin.H{"message": "pong"})

})

// 暴露 Prometheus 指标端点

r.GET("/metrics", func(c *gin.Context) {

promhttp.Handler().ServeHTTP(c.Writer, c.Request)

})

// 启动服务

if err := r.Run(":8080"); err != nil {

panic(err)

}

}

📌 访问

http://localhost:8080/metrics即可查看原始指标数据,格式如下:# HELP http_requests_total Total number of HTTP requests. # TYPE http_requests_total counter http_requests_total{method="GET",endpoint="/ping",status="200"} 1

四、Prometheus 服务发现与配置

4.1 静态配置(测试阶段)

对于开发环境,可以使用静态配置:

# prometheus.yml

global:

scrape_interval: 15s

evaluation_interval: 15s

scrape_configs:

- job_name: 'microservice'

static_configs:

- targets: ['192.168.1.100:8080', '192.168.1.101:8080']

labels:

instance: 'app-server-1'

env: 'dev'

4.2 动态服务发现(生产环境推荐)

在 Kubernetes 环境中,推荐使用 Kubernetes Service Discovery。

1. 配置文件示例

# prometheus.yml

scrape_configs:

- job_name: 'kubernetes-pods'

kubernetes_sd_configs:

- role: pod

relabel_configs:

- source_labels: [__meta_kubernetes_pod_annotation_prometheus_io_scrape]

action: keep

regex: true

- source_labels: [__meta_kubernetes_pod_annotation_prometheus_io_path]

action: replace

target_label: __metrics_path__

regex: (.+)

- source_labels: [__address__, __meta_kubernetes_pod_annotation_prometheus_io_port]

action: replace

regex: ([^:]+)(?::\d+)?;(\d+)

replacement: $1:$2

target_label: __address__

- action: labelmap

regex: __meta_kubernetes_pod_label_(.+)

- source_labels: [__meta_kubernetes_namespace]

action: replace

target_label: namespace

- source_labels: [__meta_kubernetes_pod_name]

action: replace

target_label: pod

2. 在微服务 Pod 上添加注解

# deployment.yaml

apiVersion: apps/v1

kind: Deployment

metadata:

name: user-service

spec:

replicas: 3

selector:

matchLabels:

app: user-service

template:

metadata:

labels:

app: user-service

annotations:

prometheus.io/scrape: "true"

prometheus.io/path: "/metrics"

prometheus.io/port: "8080"

spec:

containers:

- name: user-service

image: registry.example.com/user-service:v1.2

ports:

- containerPort: 8080

✅ 此时 Prometheus 将自动发现所有带有

prometheus.io/scrape=true的 Pod 并拉取/metrics端点。

五、Grafana 可视化与仪表盘设计

5.1 安装与初始化

1. 使用 Docker 快速部署

docker run -d \

--name grafana \

-p 3000:3000 \

-v ./grafana-data:/var/lib/grafana \

grafana/grafana-enterprise:latest

访问 http://localhost:3000,默认账号密码为 admin/admin。

2. 添加 Prometheus 数据源

- 进入 Configuration > Data Sources

- 添加新数据源,选择 Prometheus

- 配置:

- URL:

http://prometheus:9090 - 保存并测试连接成功

- URL:

5.2 构建核心仪表盘模板

以下是几个关键仪表盘的设计建议与 PromQL 查询示例。

1. 服务整体健康状态面板

-

标题:Service Health Overview

-

面板类型:Single Stat + Graph

-

查询:

sum by (job) (rate(http_requests_total{status=~"5.*"}[5m]))显示最近5分钟内返回5xx错误的请求数

-

图表:折线图,显示

http_requests_total按方法分类的趋势

2. 响应时间分布(百分位数)

- 标题:Request Latency (P50, P90, P99)

- 面板类型:Time Series

- 查询:

histogram_quantile(0.5, sum(rate(http_request_duration_seconds_bucket[5m])) by (le, method))histogram_quantile(0.9, sum(rate(http_request_duration_seconds_bucket[5m])) by (le, method))histogram_quantile(0.99, sum(rate(http_request_duration_seconds_bucket[5m])) by (le, method))

💡 建议设置

le标签为bucket,以便正确解析直方图数据

3. 错误率监控

- 标题:Error Rate by Endpoint

- 面板类型:Bar Gauge / Heatmap

- 查询:

sum by (endpoint) (rate(http_requests_total{status=~"5.*"}[5m])) / sum by (endpoint) (rate(http_requests_total[5m]))

4. 资源使用情况(结合 Node Exporter)

假设已部署

node-exporter,并接入 Prometheus

-

CPU Usage:

100 - (avg by(instance) (rate(node_cpu_seconds_total{mode="idle"}[5m])) * 100) -

Memory Usage:

(node_memory_MemTotal_bytes - node_memory_MemAvailable_bytes) / node_memory_MemTotal_bytes * 100

5.3 仪表盘共享与版本管理

建议将仪表盘导出为 JSON 文件,纳入 Git 管理:

// dashboards/user-service.json

{

"dashboard": {

"title": "User Service Monitoring",

"panels": [...],

"variables": [...]

},

"folder": "Microservices"

}

使用 Grafana CLI 或 CI/CD 工具(如 ArgoCD)自动部署仪表盘。

六、告警策略设计与 Alertmanager 配置

6.1 Alertmanager 基础部署

# alertmanager.yml

global:

resolve_timeout: 5m

smtp_smarthost: 'smtp.gmail.com:587'

smtp_from: 'alert@example.com'

smtp_auth_username: 'alert@example.com'

smtp_auth_password: 'your-app-password'

route:

group_by: ['alertname', 'job']

group_wait: 30s

group_interval: 5m

repeat_interval: 3h

receiver: 'email'

receivers:

- name: 'email'

email_configs:

- to: 'ops-team@company.com'

subject: 'Alert: {{ template "email.default.title" . }}'

body: '{{ template "email.default.body" . }}'

templates:

- '/etc/alertmanager/templates/*.tmpl'

启动 Alertmanager:

docker run -d \

--name alertmanager \

-p 9093:9093 \

-v ./alertmanager.yml:/etc/alertmanager/alertmanager.yml \

grafana/alertmanager

6.2 Prometheus 告警规则配置

# rules.yml

groups:

- name: microservice-alerts

interval: 5m

rules:

- alert: HighRequestErrorRate

expr: |

sum by (job) (rate(http_requests_total{status=~"5.*"}[5m])) /

sum by (job) (rate(http_requests_total[5m])) > 0.05

for: 10m

labels:

severity: warning

annotations:

summary: "High error rate detected on {{ $labels.job }}"

description: |

The error rate for {{ $labels.job }} has exceeded 5% over the last 10 minutes.

Current rate: {{ printf "%.2f" $value }}

- alert: HighLatency

expr: |

histogram_quantile(0.99, sum(rate(http_request_duration_seconds_bucket[5m])) by (le, job)) > 2

for: 15m

labels:

severity: critical

annotations:

summary: "P99 latency exceeds 2 seconds on {{ $labels.job }}"

description: |

P99 latency for {{ $labels.job }} is above 2 seconds.

- alert: LowActiveRequests

expr: |

sum by (job) (http_active_requests) < 1

for: 10m

labels:

severity: info

annotations:

summary: "Service appears idle: {{ $labels.job }}"

description: |

No active requests detected for {{ $labels.job }} for 10 minutes.

📌 将此文件挂载到 Prometheus 并加载:

# prometheus.yml

rule_files:

- "rules.yml"

6.3 告警抑制与静音策略

- 抑制:当某个服务宕机时,避免发送大量关联告警

- 静音:在维护窗口期间暂停告警

# alertmanager.yml

inhibit_rules:

- equal: ["alertname", "severity"]

equal: ["job"] # 一旦某服务有严重告警,抑制其他同级别的告警

静音示例(通过 API):

POST /api/v1/silence

{

"matchers": [

{"name": "alertname", "value": "HighRequestErrorRate"},

{"name": "job", "value": "user-service"}

],

"startsAt": "2025-04-05T00:00:00Z",

"endsAt": "2025-04-05T02:00:00Z",

"createdBy": "ops@company.com",

"comment": "Scheduled maintenance"

}

七、高级优化与最佳实践

7.1 指标命名规范

- 使用小写字母与下划线

- 前缀清晰:

http_,db_,cache_ - 避免保留字(如

request,error)

✅ 推荐:

http_requests_total

http_request_duration_seconds

❌ 避免:

RequestCount

ErrorRate

7.2 指标标签设计原则

- 标签数量控制在 3~5 个以内

- 避免高基数标签(如用户ID、IP地址)

- 使用

job,instance,env,version等通用标签

7.3 数据保留与压缩策略

# prometheus.yml

storage:

retention: 15d

tsdb:

min_block_size: 2048

max_block_size: 10240

建议根据磁盘容量调整保留时间(默认 15 天)

7.4 容灾与高可用部署

- 使用 Prometheus Operator(Kubernetes)管理集群

- 部署多个 Prometheus 实例 + Federation 支持跨集群聚合

- 使用 Thanos 或 Cortex 构建全局可观测性平台

八、总结与未来演进方向

通过本文,我们完成了从零开始构建一个完整的云原生微服务监控体系的全过程:

- ✅ 使用 Prometheus 实现细粒度指标采集

- ✅ 借助 Grafana 实现多维度可视化

- ✅ 配置 Alertmanager 实现智能告警

- ✅ 推广标准化指标设计与最佳实践

未来可进一步拓展:

- 集成 OpenTelemetry:统一指标、日志、链路追踪

- 引入 Tempo + Loki:实现分布式链路追踪与日志集中管理

- 使用 Grafana Cloud:免运维托管方案

- 机器学习异常检测:基于历史数据预测潜在故障

附录:常用 PromQL 查询汇总

| 场景 | PromQL |

|---|---|

| 5xx 错误率 | sum by(job) (rate(http_requests_total{status=~"5.*"}[5m])) / sum by(job) (rate(http_requests_total[5m])) |

| P99 延迟 | histogram_quantile(0.99, sum(rate(http_request_duration_seconds_bucket[5m])) by (le, job)) |

| 当前活跃请求数 | sum by(job) (http_active_requests) |

| CPU 利用率 | 100 - (avg by(instance) (rate(node_cpu_seconds_total{mode="idle"}[5m])) * 100) |

| 内存使用率 | (node_memory_MemTotal_bytes - node_memory_MemAvailable_bytes) / node_memory_MemTotal_bytes * 100 |

📘 参考文档

- Prometheus 官方文档: https://prometheus.io/docs

- Grafana 官方文档: https://grafana.com/docs

- OpenTelemetry: https://opentelemetry.io

作者:云原生架构师

发布日期:2025年4月5日

标签:云原生, 微服务监控, Prometheus, Grafana, 架构设计

评论 (0)